Estafas y ciberataques, entre los peligros de los chats con inteligencia artificial

Una de las maneras de identificar a estos estafadores es a través de las faltas gramaticales que cometen en los mensajes que envían a sus víctimas

*Por Sarah Yáñez-Richards |Nueva York (EFE).- Google y Microsoft están en una carrera por conseguir que sus nuevos chats con inteligencia artificial (“chatbots”), que llegarán al público próximamente, se popularicen tanto o más que sus buscadores, pero estas nuevas tecnologías llegan con nuevos riesgos para la ciberseguridad, como que se usen para crear estafas o construir programas malignos para hacer ciberataques.

Estos problemas también se ven en chatbots como el popular ChatGPT, creado por OpenAI, tecnología que también potencia el buscador de Microsoft, Bing.

Satnam Narang, ingeniero sénior de investigación en la firma de ciberseguridad Tenable, cuenta a EFE que los estafadores pueden ser unos de los grandes beneficiados por este tipo de tecnología. Los chatbots permiten crear textos en cualquier idioma en cuestión de segundos y con una gramática perfecta.

Según Narang, una de las maneras de identificar a estos estafadores es a través de las faltas gramaticales que cometen en los mensajes que envían a sus víctimas y que, si usan IA, podrán pasar más desapercibidos.

“ChatGPT puede ayudar (a los estafadores) a crear plantillas muy bien diseñadas para correos electrónicos o crear perfiles de citas cuando intentan estafar a los usuarios en aplicaciones de citas. Y cuando tengan una conversación (con la víctima) en tiempo real, los estafadores pueden pedirle a ChatGPT que les ayude a generar la respuesta que daría la persona por la que se intentan hacer pasar”, anota Narang.

Además, el experto señala que existen otros tipos de herramientas de inteligencia artificial, como DALL·E 2 -también de OpenAI- en la que los estafadores pueden crear fotografías de personas que no existen.

Este fósil de renacuajo es el más antiguo jamás descubierto

Este fósil de renacuajo es el más antiguo jamás descubierto  Después del acuerdo de paz de las FARC de Colombia, los científicos encontraron más especies nuevas

Después del acuerdo de paz de las FARC de Colombia, los científicos encontraron más especies nuevas  Premio Nobel de química 2024 para los pioneros de las proteínas Baker, Hassabis y Jumper

Premio Nobel de química 2024 para los pioneros de las proteínas Baker, Hassabis y Jumper  Investigadores descubren restos de mastodontes de la Edad de Hielo en Perú

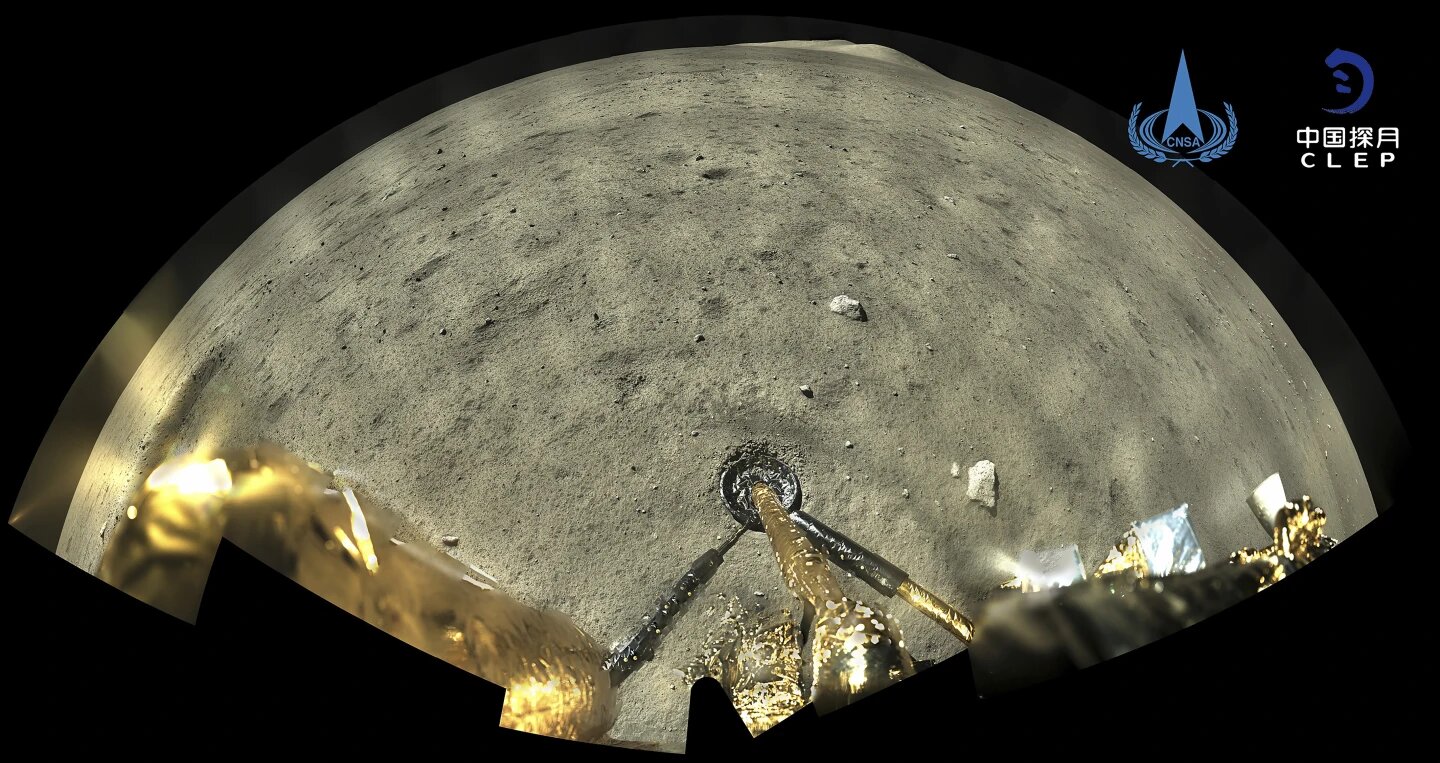

Investigadores descubren restos de mastodontes de la Edad de Hielo en Perú  Pequeñas muestras de vidrio sugieren que la luna tenía volcanes activos cuando los dinosaurios vagaban por la Tierra

Pequeñas muestras de vidrio sugieren que la luna tenía volcanes activos cuando los dinosaurios vagaban por la Tierra  Meta paraliza su plan de crear un casco de realidad virtual de alta gama para competir con Apple

Meta paraliza su plan de crear un casco de realidad virtual de alta gama para competir con Apple